Le règlement sur l’IA (AI Act) est le tout premier cadre juridique en matière d’intelligence artificielle. Cette règlementation européenne prévoit des « mesures [qui] garantiront la sécurité et les droits fondamentaux des personnes et des entreprises en matière d’IA ». Décryptage de la vocation et des enjeux de ce texte avec nos experts Advens.

Pourquoi l’AI Act, un règlement sur l’IA ?

Approuvé en mars 2024 par le Parlement européen puis en mai suivant par le Conseil de l’UE, le règlement sur l’IA fait figure de précurseur. Il s’agit en effet du premier texte au monde qui a vocation, non pas à limiter la création d’intelligences artificielles, mais à bâtir des règles communes pour son développement et sa mise sur le marché. Ce règlement entend ainsi garantir la qualité des IA européennes.

« Le règlement sur l’IA est un règlement “produit” : il propose des standards pour uniformiser et réguler l’utilisation et la production de systèmes d’IA. C’est un premier corps de règles qui sera affiné par la suite. »

Alexandre Coroir – Consultant cybersécurité – Advens

Contrairement à une directive, pas de transposition à attendre ici : dès publication au Journal officiel européen, le règlement sera applicable de façon homogène dans toute l’Union Européenne, comme cela a pu être le cas par exemple avec le RGPD. À terme, des règles plus directives envers d’autres types d’IA, appelées actes d’exécution, viendront enrichir les lignes directrices posées par ce règlement très général.

Que faut-il retenir de l’AI Act, le règlement sur l’Intelligence Artificielle ?

Définition

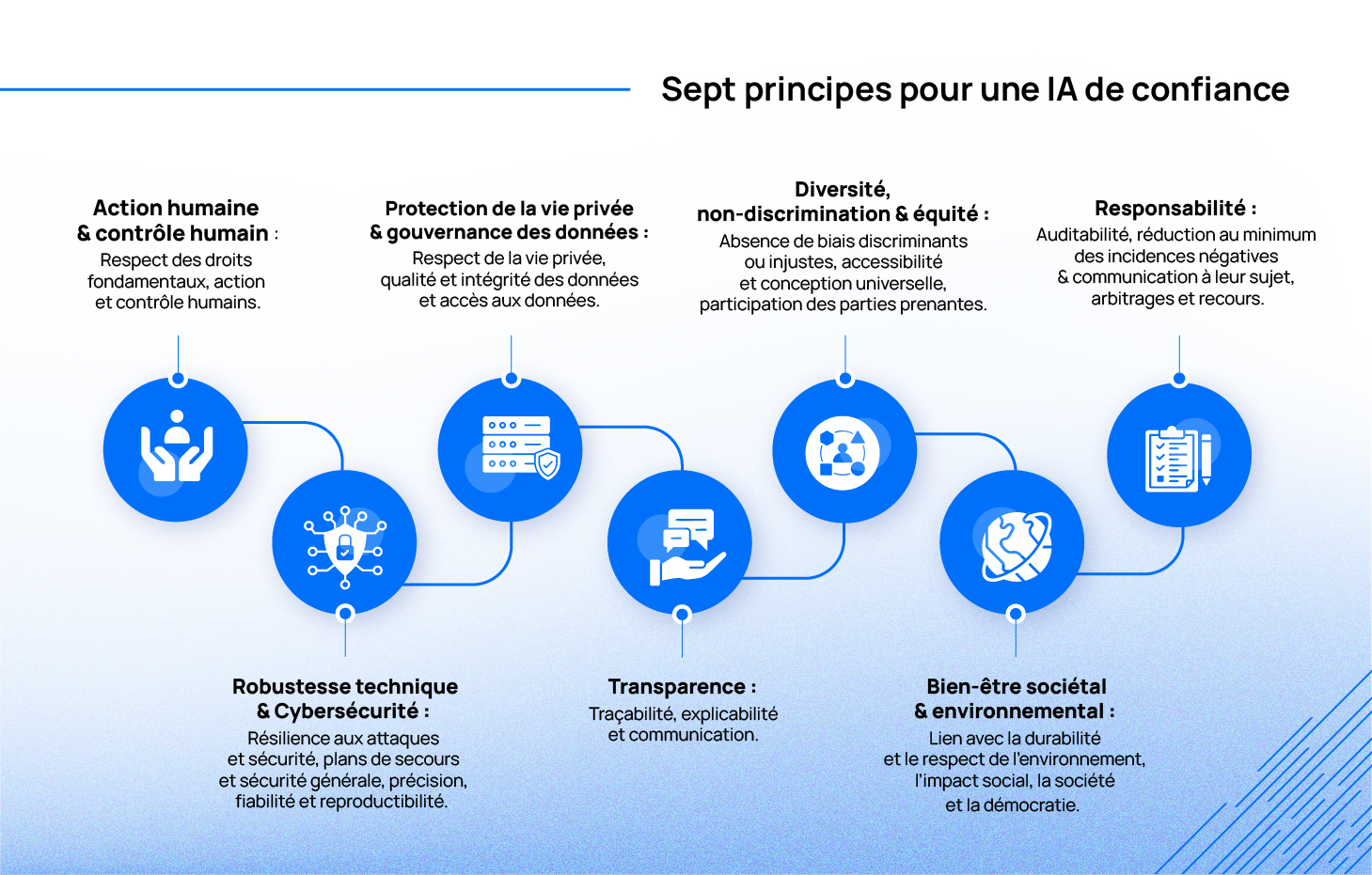

Le règlement sur l’IA reprend la définition et les sept principes établis lors d’une première réflexion sur la relation entre intelligence artificielle et humanité menée par l’OCDE dès 2019. Un système d’IA désigne ainsi « un système automatisé qui est conçu pour fonctionner à différents niveaux d’autonomie et peut faire preuve d’une capacité d’adaptation après son déploiement, et qui, pour des objectifs explicites ou implicites, déduit, à partir des entrées qu’il reçoit, la manière de générer des sorties telles que des prédictions, du contenu, des recommandations ou des décisions qui peuvent influencer les environnements physiques ou virtuels ».

Catégorisation

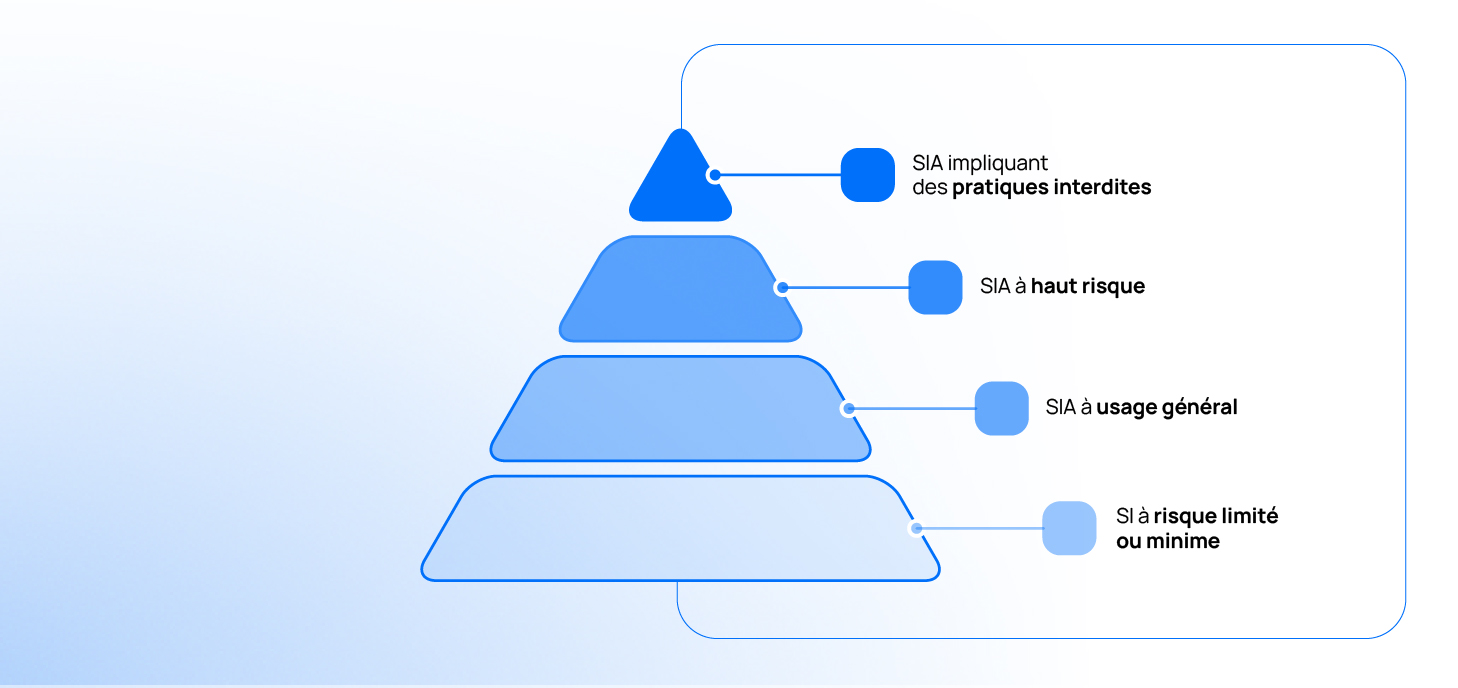

Le règlement européen sur l’IA établit également quatre niveaux de risques pour les systèmes d’IA (SIA).

- Le niveau de risque le plus élevé regroupe les SIA impliquant des pratiques interdites tels que les systèmes de catégorisation biométrique basés sur des caractéristiques sensibles, la collecte de données faciales non ciblée, la reconnaissance des émotions, etc. Les systèmes d’IA utilisés à des fins de défense sont exclus du règlement, car régis par d’autres textes ou jurisprudences.

- Les SIA à haut risque, que le règlement entend encadrer, sont listés dans les annexes du texte. Ces dernières seront mises à jour pour suivre l’évolution des technologies. À ce jour, elles incluent par exemple les systèmes de vidéo protection.

- Les SIA à usage général comme les chatbots ou la génération de contenu multimédia devront répondre à des exigences de transparence minimales.

- Enfin, les autres usages des SIA, considérés à risque limité ou minime, ne font pas l’objet d’obligation à l’égard de ce règlement.

Institutions

Le texte prévoit enfin des instances pour améliorer la gouvernance européenne sur le sujet. Il crée ainsi une nouvelle autorité, le Comité européen de l’intelligence artificielle, pour harmoniser les pratiques administratives au sein de l’Union, formuler des avis et recueillir les bonnes pratiques et les partager aux États membres.

« En parallèle, une autorité nationale compétente sera désignée pour assurer la bonne mise en application et mise en œuvre du texte, fournir des orientations et conseils ou encore émettre des sanctions, à l’image de ce que fait la CNIL dans le cadre du RGPD. »

Romane Moillic – Consultante cybersécurité – Advens

En cas de non-conformité, les sanctions seront données par les autorités nationales en fonction du niveau de violation constaté. Leur montant pourra aller de 1,5 % à 7 % du chiffre d’affaires (CA) mondial ou s’élever à une amende chiffrée de 7,5 M, 15 M ou 35 M d’euros pour les institutions publiques sans CA par exemple. En règle générale, le montant le plus élevé sera appliqué, sauf dans le cas des TPE/PME qui bénéficieront du montant le plus bas entre l’amende proportionnelle et l’amende fixe .

AI Act : quelles conséquences en entreprise ?

Voici les principales étapes d’application du texte qui se dessinent :

- Désigner un pilote ou un référent IA

Dans certaines organisations, il pourrait s’agir de la personne chargée de la protection des données (DPO) sous réserve d’une certaine maitrise technique. - Cartographier les SIA en interne

Les identifier ainsi que les données traitées, etc. - Qualifier les SIA selon les quatre niveaux présentés plus haut

- Documenter comment ces SIA fonctionnent

Sous la forme d’un document technique avancé - Appliquer les sept grands principes éthiques pour une IA de confiance

Ceux-ci émanent du groupe d’experts missionnés par la Commission européenne en 2018.

Quel calendrier pour se conformer au règlement sur l’IA ?

Le règlement sur l’IA, AI Act, sera pleinement applicable deux ans après sa publication au Journal officiel européen (imminente courant juillet 2024), à échéance des étapes suivantes :

- 6 mois après l’entrée en vigueur, interdiction de certaines pratiques d’IA inacceptables comme les systèmes de notation de la population, la prédiction pénale, etc.

- 12 mois après l’entrée en vigueur, nomination des autorités compétentes des États membres

- 18 mois après l’entrée en vigueur, acte d’exécution de la Commission européenne sur le suivi après commercialisation

- 24 mois après l’entrée en vigueur, application des mesures de sanction pour les SIA à haut risque non conformes et non régulés par ailleurs

- 36 mois après l’entrée en vigueur, application des mesures de sanction pour les SIA à haut risque non conformes et régulés par ailleurs

- 2030, entrée en vigueur des obligations pour certains systèmes d’IA relatifs à la liberté, la sécurité et la justice.

Pour inciter à la mise en conformité pendant cette période transitoire, la Commission européenne a lancé une initiative volontaire, baptisée Pacte sur l’IA.

Résonnances cyber et internationale

Il est assez difficile d’évaluer la portée de ce règlement en matière de cybersécurité car cette dimension n’y est pas mentionnée explicitement et ne fait pas partie des cas étudiés. Le règlement évoque simplement la nécessité de garantir la sécurité des systèmes d’information sans plus de détails pour l’instant. Des codes de conduite sur le sujet devraient néanmoins être publiés à l’avenir. Il faudra donc se pencher sur la question tôt ou tard.

En attendant, nous recommandons de suivre la nouvelle norme ISO42001 pour sécuriser les SIA : elle spécifie des exigences pour l’établissement, la mise en œuvre, la tenue à jour et l’amélioration continue d’un système de management de l’intelligence artificielle (SMIA) tout en abordant les défis que constituent les considérations éthiques, la transparence et l’apprentissage continu.

La résonnance internationale quant à elle est déjà là. Dans le sillage de l’AI Act, le Conseil de l’Europe a adopté en mai 2024 le 1er traité international contraignant.

« L’UE est la première à avoir proposé un encadrement général des SIA. Alors qu’aujourd’hui, certains États et Organisations internationales en sont encore à s’organiser pour se préparer à encadrer, d’autres se lancent sur le chemin législatif, notamment sur des aspects sectoriels. »

Solene Vizier – Consultante cybersécurité – Advens

Cette règlementation confère donc à l’Europe un statut de pionnière en matière de régulation des intelligences artificielles : un « équilibre parfait entre innovation et sécurité » salué par le commissaire européen, Thierry Breton.